big data big data |

|

BiblioMap

BiblioMap

Definitionen

Definitionen

Bezeichnet Datenmengen, die zu gross,

zu komplex oder zu schnelllebig sind, um sie mit

klassischen Methoden der Datenverarbeitung

auszuwerten.

Bezeichnet Datenmengen, die zu gross,

zu komplex oder zu schnelllebig sind, um sie mit

klassischen Methoden der Datenverarbeitung

auszuwerten. Die Entwicklungen, die unter dem unscharfen Sammelbegriff „Big Data“ gefasst werden, zielen vor allem ab auf die Zusammenführung und Verarbeitung von großen und unterschiedlichen Datensätzen, d. h. die in ihren Formaten heterogen sein können (z. B. Zahlen-, Bild-, Text-, Video-, Audioformate) und in unterschiedlichen Kontexten erfasst wurden

Die Entwicklungen, die unter dem unscharfen Sammelbegriff „Big Data“ gefasst werden, zielen vor allem ab auf die Zusammenführung und Verarbeitung von großen und unterschiedlichen Datensätzen, d. h. die in ihren Formaten heterogen sein können (z. B. Zahlen-, Bild-, Text-, Video-, Audioformate) und in unterschiedlichen Kontexten erfasst wurden Der Begriff „Big Data“ bezeichnet die Entwicklung und den Einsatz von Technologien, welche es erlauben, dem richtigen Nutzer zur rechten Zeit die richtigen Informationen aus den in unserer Gesellschaft seit längerem exponentiell anwachsenden Datenbeständen zu liefern. Dabei besteht neben der Herausforderung, immer grössere Datenvolumen in immer kürzerer Zeit zu verarbeiten, auch die Schwierigkeit, mit der zunehmenden Heterogenität der Formate, der Komplexität und der Verlinkung der Daten fertig zu werden.

Der Begriff „Big Data“ bezeichnet die Entwicklung und den Einsatz von Technologien, welche es erlauben, dem richtigen Nutzer zur rechten Zeit die richtigen Informationen aus den in unserer Gesellschaft seit längerem exponentiell anwachsenden Datenbeständen zu liefern. Dabei besteht neben der Herausforderung, immer grössere Datenvolumen in immer kürzerer Zeit zu verarbeiten, auch die Schwierigkeit, mit der zunehmenden Heterogenität der Formate, der Komplexität und der Verlinkung der Daten fertig zu werden. Zusammenfassend können wir unter Big Data die Entwicklung und den Einsatz von Technologien verstehen, welche es erlauben, dem richtigen Nutzer1 zur rechten Zeit die richtigen Informationen aus den seit längerem exponentiell anwachsenden Datenbeständen zu liefern. Dabei besteht neben der Herausforderung, immer grössere Datenvolumen in immer kürzerer Zeit zu verarbeiten, auch die Schwierigkeit, mit der zunehmenden Heterogenität der Formate, der Komplexität und der Verlinkung der Daten fertig zu werden (Chen, Chiang, & Storey, 2012; Lycett, 2013).

Zusammenfassend können wir unter Big Data die Entwicklung und den Einsatz von Technologien verstehen, welche es erlauben, dem richtigen Nutzer1 zur rechten Zeit die richtigen Informationen aus den seit längerem exponentiell anwachsenden Datenbeständen zu liefern. Dabei besteht neben der Herausforderung, immer grössere Datenvolumen in immer kürzerer Zeit zu verarbeiten, auch die Schwierigkeit, mit der zunehmenden Heterogenität der Formate, der Komplexität und der Verlinkung der Daten fertig zu werden (Chen, Chiang, & Storey, 2012; Lycett, 2013). Während der Begriff Big Data sehr geläufig ist, gibt

es keine einheitliche Definition dessen; sie wird abwechselnd

in Bezug zu Datensätzen, Datenbanken

oder gar der Beschreibung einer auf Daten basierenden

Technologie synonym verwendet. In diesem Beitrag

soll diejenige Definition angenommen werden, die

sich streng auf Datenmengen bezieht.

Unter Big Data werden Datenmengen betrachtet,

die weder manuell noch durch herkömmliche Verarbeitungstechnologien

verwendet werden können (vgl.

Gartner Glossary, 2020). Die drei Haupteigenschaften

von Big Data beziehen sich auf den Umfang (Volume),

die Schnelllebigkeit (Velocity) und die Heterogenität

(Variety) von Daten.

Während der Begriff Big Data sehr geläufig ist, gibt

es keine einheitliche Definition dessen; sie wird abwechselnd

in Bezug zu Datensätzen, Datenbanken

oder gar der Beschreibung einer auf Daten basierenden

Technologie synonym verwendet. In diesem Beitrag

soll diejenige Definition angenommen werden, die

sich streng auf Datenmengen bezieht.

Unter Big Data werden Datenmengen betrachtet,

die weder manuell noch durch herkömmliche Verarbeitungstechnologien

verwendet werden können (vgl.

Gartner Glossary, 2020). Die drei Haupteigenschaften

von Big Data beziehen sich auf den Umfang (Volume),

die Schnelllebigkeit (Velocity) und die Heterogenität

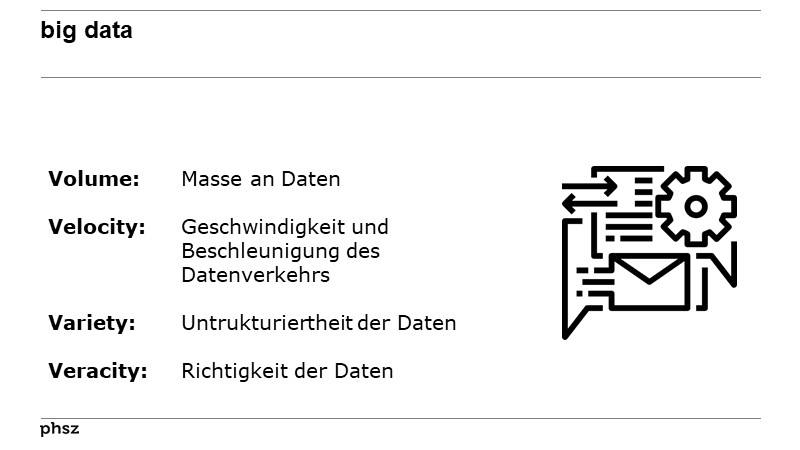

(Variety) von Daten. Was aber bezeichnet „Big Data“? Häufig wird Big Data über die drei „V“-Begriffe

charakterisiert: „Volume“ im Sinne der Masse an Daten, zu deren Bearbeitung konventionelle

Datenbanksysteme nicht mehr ausreichen und verteilte, parallele Systeme

eingesetzt werden (z. B. Hadoop und MapReduce). „Velocity“ bezeichnet die Geschwindigkeit

bzw. Beschleunigung des Datenverkehrs bis hin zur Analyse in Echtzeit, und mit „Variety“ ist die vielfältige, auch unstrukturierte Beschaffenheit der Daten jedweden Formats gemeint (Text-, Bild-, Audio- und Videodaten, Metadaten usw.). Ergänzt

wird diese Liste der V-Begriffsmerkmale bisweilen durch „Value“, also der bereits

angesprochenen, monetären Verwertung, und „Veracity“, der Unsicherheit und Unschärfe

der Daten und ihrer Analysen.

Was aber bezeichnet „Big Data“? Häufig wird Big Data über die drei „V“-Begriffe

charakterisiert: „Volume“ im Sinne der Masse an Daten, zu deren Bearbeitung konventionelle

Datenbanksysteme nicht mehr ausreichen und verteilte, parallele Systeme

eingesetzt werden (z. B. Hadoop und MapReduce). „Velocity“ bezeichnet die Geschwindigkeit

bzw. Beschleunigung des Datenverkehrs bis hin zur Analyse in Echtzeit, und mit „Variety“ ist die vielfältige, auch unstrukturierte Beschaffenheit der Daten jedweden Formats gemeint (Text-, Bild-, Audio- und Videodaten, Metadaten usw.). Ergänzt

wird diese Liste der V-Begriffsmerkmale bisweilen durch „Value“, also der bereits

angesprochenen, monetären Verwertung, und „Veracity“, der Unsicherheit und Unschärfe

der Daten und ihrer Analysen. Although big data has become a popular term and a hyped concept

in recent years, definitional clarity in relation to big data is

surprisingly elusive. In technical terms, big data refers to data sets

that are huge in volume (at the scale of petabytes, exabytes and

zettabytes); highly diverse in type and nature; generated

continuously at great velocity in or near real-time; exhaustive in

scope (enabling the capture of entire populations – or ‘n=all’ – rather

than sampled selections); fine-grained in resolution at the level of

indexing individual units; combinable with other networks of

datasets; and flexible and scalable enough for new fields to be

added and to expand in size rapidly (Boyd and Crawford 2013;

Mayer-Schönberger and Cukier 2013; Kitchin 2014a, 2014b). Kitchin

and McArdle (2015) suggest that exhaustivity and velocity are

perhaps the two most key traits of big data systems. These qualities

of big data are in contrast to earlier methods of data collection and

analysis that progressed using data produced in tightly controlled

ways using sampling techniques that limited their scope, variety,

temporality and size (Kitchin and McArdle 2015).

Although big data has become a popular term and a hyped concept

in recent years, definitional clarity in relation to big data is

surprisingly elusive. In technical terms, big data refers to data sets

that are huge in volume (at the scale of petabytes, exabytes and

zettabytes); highly diverse in type and nature; generated

continuously at great velocity in or near real-time; exhaustive in

scope (enabling the capture of entire populations – or ‘n=all’ – rather

than sampled selections); fine-grained in resolution at the level of

indexing individual units; combinable with other networks of

datasets; and flexible and scalable enough for new fields to be

added and to expand in size rapidly (Boyd and Crawford 2013;

Mayer-Schönberger and Cukier 2013; Kitchin 2014a, 2014b). Kitchin

and McArdle (2015) suggest that exhaustivity and velocity are

perhaps the two most key traits of big data systems. These qualities

of big data are in contrast to earlier methods of data collection and

analysis that progressed using data produced in tightly controlled

ways using sampling techniques that limited their scope, variety,

temporality and size (Kitchin and McArdle 2015). Bemerkungen

Bemerkungen

Big Data eröffnet der Scharfschützen-Methode ein ganz neues Spielfeld. Nur dass der Scharfschütze hier nicht erst schießen muss, um die Zielscheibe so um die Kugellöcher zu malen, dass das Zentrum in der Mitte liegt. Es gibt nämlich schon Millionen Kugellöcher. Daher braucht der Scharfschütze nur mit einem schnellen Suchalgorithmus nach einem Muster Ausschau zu halten, das den Eindruck hervorruft, die Zielscheibe sei zuerst aufgestellt worden und die Löcher kamen nachher. Abermals ist das nicht Big Data vorzuwerfen, sondern der Art, wie es verwendet wird. Man kann natürlich auf eine unerwartete Korrelation stoßen, aber bevor man sie als Faktum verkündet, sollte man unabhängig überprüfen, ob sie auch für andere Zeitpunkte oder Menschengruppen gilt. Lässt man diesen Schritt aus und präsentiert das Zufallsmuster, über das man gestolpert ist, als wissenschaftliches Ergebnis, folgt man der Strategie des Scharfschützen.

Big Data eröffnet der Scharfschützen-Methode ein ganz neues Spielfeld. Nur dass der Scharfschütze hier nicht erst schießen muss, um die Zielscheibe so um die Kugellöcher zu malen, dass das Zentrum in der Mitte liegt. Es gibt nämlich schon Millionen Kugellöcher. Daher braucht der Scharfschütze nur mit einem schnellen Suchalgorithmus nach einem Muster Ausschau zu halten, das den Eindruck hervorruft, die Zielscheibe sei zuerst aufgestellt worden und die Löcher kamen nachher. Abermals ist das nicht Big Data vorzuwerfen, sondern der Art, wie es verwendet wird. Man kann natürlich auf eine unerwartete Korrelation stoßen, aber bevor man sie als Faktum verkündet, sollte man unabhängig überprüfen, ob sie auch für andere Zeitpunkte oder Menschengruppen gilt. Lässt man diesen Schritt aus und präsentiert das Zufallsmuster, über das man gestolpert ist, als wissenschaftliches Ergebnis, folgt man der Strategie des Scharfschützen. Verwandte Objeke

Verwandte Objeke

Verwandte Begriffe (co-word occurance) |  Daten Daten data(0.07), data(0.07),  Algorithmus Algorithmus algorithm(0.04) algorithm(0.04) |

Verwandte Aussagen | big data gefährdet Privatsphäre big data fördert die Arbeitslosigkeit Digitalisierung ermöglicht big data big data fördert machine learning |

CoautorInnenlandkarte

CoautorInnenlandkarte

Relevante Personen

Relevante Personen

Viktor

ViktorMayer-Schönberger

Kenneth

KennethCukier

Häufig erwähnende Personen

Häufig erwähnende Personen

Häufig co-zitierte Personen

Häufig co-zitierte Personen

Statistisches Begriffsnetz

Statistisches Begriffsnetz

11 Vorträge von Beat mit Bezug

11 Vorträge von Beat mit Bezug

- Digidaktik oder Datadaktik?

Universität Frankfurt, 20.09.2019

- Mehr als 0 und 1?

CAS Digital Leadership der PHZH, 03.07.2020

- Digitalisieren Sie noch?

ICT-Kadertag "Begleiten in der Mediengesellschaft" der PHZG

Gemeindesaal Steinhausen, 16.09.2020

- Schule, wie hältst du es mit den Daten?

Schulleitungstagung der Stadt Zürich

Zürich, 21.01.2021

- Unsere Schule in der digitalen Welt

Schulleitungsforum Basellandschaft, 26.05.2021

- Was machen wir mit der Digitalisierung?

Bildungsrat des Kantons Zug, 23.06.2021

- Mehr als 0 und 1?

Ausgabe 2021

CAS Digital Leadership, 09.07.2021

- Digidaktik oder Datadaktik

Was machen wir mit der Digitalisierung an den Schulen?

GDI Rüschlikon, 22.03.2022

- Gedanken zu neuen, neuen Lernwelten

Begegnungstag, hep Verlag, 26.03.2022

- Mehr als 0 oder 1?

Ausgabe 2023

CAS Digital Leadership in Education, PHZH, 08.07.2022

- Digi-was?

Austausch mit dem AVS Schwyz, 24.01.2023

4 Einträge in Beats Blog

4 Einträge in Beats Blog

2 Erwähnungen auf anderen Websites im Umfeld von Beat Döbeli Honegger

2 Erwähnungen auf anderen Websites im Umfeld von Beat Döbeli Honegger

| Website | Webseite | Datum |

|---|---|---|

| Grundlagen der Informatik 16/17 | Datenstrukturen | 30.06.2016 |

| Informatikdidaktik-Wiki der PHSZ | Big Data | 22.05.2018 |

Zitationsgraph (Beta-Test mit vis.js)

Zitationsgraph (Beta-Test mit vis.js)

Zeitleiste

Zeitleiste

375 Erwähnungen

375 Erwähnungen

- «Macht euch von den US-Servern los!» (Helen Nissenbaum, Alexandra Kedves)

- «Swiss Pass hat Potenzial zur Massenüberwachung» (Felix Huber, Matthias Schüssler)

- Dein Algorithmus - meine Meinung! - Algorithmen und ihre Bedeutung für Meinungsbildung und Demokratie (BLM Bayerische Landeszentrale für neue Medien)

- Deep neural networks are more accurate than humans at detecting sexual orientation from facial images - Preprint (Michal Kosinski, Yilun Wang)

- So wird Fussball entschlüsselt (Joachim Laukenmann)

- The Global Expansion of AI Surveillance (Steven Feldstein)

- Personalized Learning Technology and the New Behaviorism - Beyond Freedom and Dignity (Norm Friesen)

- «Wir brauchen Daten, noch mehr Daten, bessere Daten» (Sigrid Hartong)

- Smart Machines - IBM's Watson and the Era of Cognitive Computing (John Kelly, Steve Hamm)

- Research with Children - Perspectives and Practices (Pia Christensen, Allison James) (2000)

- 3. Researching children and childhood in the digital age - (3rd edition) (Sonia Livingstone, Alicia Blum-Ross)

- 3. Researching children and childhood in the digital age - (3rd edition) (Sonia Livingstone, Alicia Blum-Ross)

- Datafying education - How digital assessment practices reconfigure the organisation of learning (Juliane Jarke, Andreas Breiter) (2005)

- Handbuch Medienpädagogik (Uwe Sander, Friederike von Gross, Kai-Uwe Hugger) (2008)

- Die Internet-Falle - Google+, Facebook, Staatstrojaner - Was Sie für Ihren sicheren Umgang mit dem Netz wissen müssen (Thomas R. Köhler) (2010)

- A Billion Wicked Thoughts - What the World's Largest Experiment Reveals About Human Desire (What the Internet Tells Us About Sexual Relationships) (Sai Gaddam, Ogi Odas) (2011)

- The Signal and the Noise (Nate Silver) (2012)

- To Save Everything, Click Here - The Folly of Technological Solutionism (Evgeny Morozov) (2013)

- Who Owns the Future? (Jaron Lanier) (2013)

- Predictive Analytics - The Power to Predict Who Will Click, Buy, Lie, or Die (Eric Siegel, Thomas H. Davenport) (2013)

- Entering the Shift Age - The End of the Information Age and the New Era of Transformation (2013)

- Big Data - GDI Impuls 1/2013 (2013)

- Big Data - A Revolution That Will Transform How We Live, Work and Think (Viktor Mayer-Schönberger, Kenneth Cukier) (2013)

- digitale agenda 2.0 - auf dem weg zu «smart switzerland» (ICTswitzerland, economosuisse) (2013)

- «Big Data ist eine Herausforderung für 400 Jahre Aufklärung» - Samstagsinterview mit Ruedi Noser, FDP-Nationalrat, Inhaber der in der Informationstechnologie tätigen Noser-Gruppe (Ruedi Noser, Rudolf Burger) (2013)

- Privatsphäre weg, Jobs weg - aber ein virtuelles Wunschkonzert ohne Ende - Wie der frühere Google-Chef Eric Schmidt die digitale Revolution einschätzt (Philipp Löpfe) (2013)

- Age of Context - Mobile, Sensors, Data and the Future of Privacy (Robert Scoble, Shel Israel) (2013)

- Die Diktatur der Daten (Michèle Binswanger) (2013)

- Dataismus und Nihilismus (Byung-Chul Han) (2013)

- Dataismus und Optimismus (Alexander Pschera) (2013)

- Machine Learning with R (Brett Lantz) (2013)

- MOOCs - Massive Open Online Courses - Offene Bildung oder Geschäftsmodell? (Rolf Schulmeister) (2013)

- Der Beginn und das Ende von OPEN - Chronologie der MOOC-Entwicklung

- Der Beginn und das Ende von OPEN - Chronologie der MOOC-Entwicklung

- Opfer der Automatisierung - Studie prophezeit: 47 Prozent aller Jobs stehen vor dem Aus (Ralf Grötker) (2013)

- «Ein Sputnik-Schock tut uns gut» (Dirk Helbing, Michèle Binswanger) (2013)

- Big Brother und der intelligente Autositz - Big Data ist da und wird unser Leben umkrempeln. Wie und warum schildern zwei neu erschienene Bücher. (Philipp Löpfe) (2013)

- Big Privacy - Bridging Big Data and the Personal Data Ecosystem Through Privacy by Design (Ann Cavoukian, Drummond Reed) (2013)

- Der totale Vertrauensverlust - warum wir alle Paranoiker sind (Peter Schneider) (2013)

- Das grosse Rauschen - Warum die Datengesellschaft mehr Menschenverstand braucht (2013)

- The Second Machine Age - Work, Progress, and Prosperity in a Time of Brilliant Technologies (Erik Brynjolfsson, Andrew McAfee) (2014)

- The Naked Future - What Happens in a World That Anticipates Your Every Move? (Patrick Tucker) (2014)

- Psychopolitik - Neoliberalismus und die neuen Machttechniken (Byung-Chul Han) (2014)

- Zero to One - Wie Innovation unsere Gesellschaft rettet (Peter Thiel, Blake Masters) (2014)

- Zum Frühstück gibt's Apps - Der tägliche Kampf mit der Digitalen Ambivalenz (Gerald Lembke, Ingo Leipner) (2014)

- 18. Epilog

- 18. Epilog

- The Data Revolution (Rob Kitchin) (2014)

- «Wir sind viel vorhersehbarer, als wir glauben» (Viktor Mayer-Schönberger, Philipp Löpfe) (2014)

- «Wir werden zur Datenwolke» (Philipp Theisohn, Constantin Seibt) (2014)

- Google versagt bei Grippe-Vorhersagen (Christian Weber) (2014)

- The Zero Marginal Cost Society - The Internet of Things, the Collaborative Commons, and the Eclipse of Capitalism (Jeremy Rifkin) (2014)

- Kämpf um deine Daten (Max Schrems) (2014)

- Überwachung total - Wie wir in Zukunft unsere Daten schützen (Peter Schaar) (2014)

- Freie Bildungsmedien und Digitale Archive - Medien - Wissen - Bildung (Petra Missomelius, Wolfgang Sützl, Theo Hug, Petra Grell, Rudolf Kammerl) (2014)

- Lernen mit big data (Viktor Mayer-Schönberger, Kenneth Cukier) (2014)

- 2. Wandel

- 3. Plattformen

- 4. Folgen

- 5. Morgengrauen

- 2. Wandel

- From Computational Thinking to Systems Thinking - A conceptual toolkit for sustainability computing (Steve Easterbrook) (2014)

- Sie wissen alles - Wie intelligente Maschinen in unser Leben eindringen und warum wir für unsere Freiheit kämpfen müssen (Yvonne Hofstetter) (2014)

- Engelbarts Traum - Wie der Computer uns Lesen und Schreiben abnimmt (Henning Lobin) (2014)

- 10. Alte und neue Träume

- ISSEP 2014 - Informatics in Schools - Teaching and Learning Perspectives (Yasemin Gülbahar, Erinç Karataş) (2014)

- Das Neue Spiel - Strategien für die Welt nach dem digitalen Kontrollverlust (Michael Seemann) (2014)

- ICER 2014 - International Computing Education Research Conference, ICER 2014, Glasgow, United Kingdom, August 11-13, 2014 (Quintin I. Cutts, Beth Simon, Brian Dorn) (2014)

- Big data and data management - a topic for secondary computing education (Andreas Grillenberger 0001) (2014)

- Big data and data management - a topic for secondary computing education (Andreas Grillenberger 0001) (2014)

- SIGCSE 2014 - The 45th ACM Technical Symposium on Computer Science Education, SIGCSE '14, Atlanta, GA, USA - March 05 - 08, 2014 (J. D. Dougherty, Kris Nagel, Adrienne Decker, Kurt Eiselt) (2014)

- Developing a game-based learning curriculum for «Big Data» in middle school (abstract only) (Allison G. Martínez-Arocho, Philip Sheridan Buffum, Kristy Elizabeth Boyer) (2014)

- CS principles goes to middle school - learning how to teach "Big Data" (Philip Sheridan Buffum, Allison G. Martínez-Arocho, Megan Hardy Frankosky, Fernando J. Rodríguez, Eric N. Wiebe, Kristy Elizabeth Boyer) (2014)

- Wir geben die Verantwortung ab (Jaron Lanier) (2014)

- «Bedroht ist unsere persönliche Würde» (Yvonne Hofstetter, Michèle Binswanger) (2014)

- Im Bett mit dem Kapitalismus (Christoph Fellmann) (2014)

- Das elektronische Schulbuch (2014) - Fachdidaktische Anforderungen und Ideen treffen auf Lösungsvorschläge der Informatik (Michael Schuhen, Manuel Froitzheim) (2014)

- Zwischen Behauptung, Intention und Evidenz - Zur Notwendigkeit die Entwicklung von und die Arbeit mit elektronischen Schulbüchern empirisch zu begleiten (Waltraud Schreiber, Florian Sochatzy, Marcus Ventzke)

- Zwischen Behauptung, Intention und Evidenz - Zur Notwendigkeit die Entwicklung von und die Arbeit mit elektronischen Schulbüchern empirisch zu begleiten (Waltraud Schreiber, Florian Sochatzy, Marcus Ventzke)

- Per Mausklick zum Tatort (Adrian Lobe) (2014)

- Vielfalt der Informatik (Anja Zeising, Claude Draude, Heidi Schelhowe, Susanne Maass) (2014)

- Die Informatisierung der Lebenswelt - Der Strategiewandel algorithmischer Alltagsbewältigung (Hans D. Hellige)

- Die Informatisierung der Lebenswelt - Der Strategiewandel algorithmischer Alltagsbewältigung (Hans D. Hellige)

- Statistik für alle - Die 101 wichtigsten Begriffe anschaulich erklärt (Walter Krämer) (2015)

- The Master Algorithm - How the Quest for the Ultimate Learning Machine Will Remake Our World (Pedro Domingos) (2015)

- Inventing the Future - Postcapitalism and a World Without Work (Nick Srnicek, Alex Williams) (2015)

- Digitale Datenbanken - Eine Medientheorie im Zeitalter von Big Data (Marcus Burkhardt) (2015)

- Digital Sociology (Deborah Lupton) (2015)

- coding/learning - software and digital data in education (Ben Williamson) (2015)

- Choosing Not to Choose - Understanding the Value of Choice (Cass R. Sunstein) (2015)

- The Black Box Society - The Secret Algorithms That Control Money and Information (Frank Pasquale) (2015)

- Menschheit steht vor dem grössten Umbruch seit der industriellen Revolution (Joachim Laukenmann) (2015)

- Im roten Bereich (Jörg Schindler, Wolf Wiedmann-Schmidt) (2015)

- Cognitive Computing and Big Data Analytics (Judith S. Hurwitz, Marcia Kaufman, Adrian Bowles) (2015)

- Big Data - Zeitschrift APuZ 11-12/2015 (2015)

- «Ich habe doch nichts zu verbergen» (Evgeny Morozov)

- Politikfeld Big Data - Hoffnungen, Vorhaben und viele offene Fragen

- Was ist Big Data? - Zur Beschleunigung des menschlichen Erkenntnisprozesses (Viktor Mayer-Schönberger)

- Von Big zu Smart - zu Sustainable? (Rolf Kreibich)

- Auf dem Weg zum Dr. Algorithmus? - Potenziale von Big Data in der Medizin (Peter Langkafel)

- Verkannte Revolution - Big Data und die Macht des Marktes - Essay (Yvonne Hofstetter)

- «Ich habe doch nichts zu verbergen» (Evgeny Morozov)

- SIGCSE 2015 - Kansas City, MO, USA, March 4-7, 2015 (Adrienne Decker, Kurt Eiselt, Carl Alphonce, Jodi Tims) (2015)

- Situating Computational Thinking with Big Data - Pedagogy and Technology (Abstract Only) (Austin Cory Bart) (2015)

- Raspberry HadooPI - A Low-Cost, Hands-On Laboratory in Big Data and Analytics (Abstract Only) (Kenneth Fox, William M. Mongan, Jeffrey L. Popyack) (2015)

- Big Data in Computer Science Education Research (Orit Hazzan, Clifford A. Shaffer) (2015)

- Using Big Data and BKT to Evaluate Course Resources - (Abstract Only) (Zachary MacHardy, Daniel D. Garcia) (2015)

- Data-Ism - The Revolution Transforming Decision Making, Consumer Behavior, and Almost Everything Else (Steve Lohr) (2015)

- Des Googles Kern und andere Spinnennetze - Die Architektur der digitalen Gesellschaft (Arno Rolf, Arno Sagawe) (2015)

- Grosse Schwester, sprich mit mir (Peter Praschl) (2015)

- Technologischer Totalitarismus - Eine Debatte (Frank Schirrmacher) (2015)

- Warum wir jetzt kämpfen müssen (Martin Schulz) (2014)

- Schützt den Datenkörper! (Juli Zeh) (2014)

- Warum wir jetzt kämpfen müssen (Martin Schulz) (2014)

- Homo Deus - Eine Geschichte von Morgen (Yuval Noah Harari) (2015)

- Digital Didactical Designs - Teaching and Learning in CrossActionSpaces (Isa Jahnke) (2015)

- 7. Conclusion and Looking Forward ...

- Digital Is Destroying Everything - What the Tech Giants Won’t Tell You about How Robots, Big Data and Algorithms Are Radically Remaking Your Future (Andrew V Edwards) (2015)

- Proceedings of the Workshop in Primary and Secondary Computing Education, WiPSCE 2015, London, United Kingdom, November 9-11, 2015 (Judith Gal-Ezer, Sue Sentance, Jan Vahrenhold) (2015)

- Bringing the Innovations in Data Management to CS Education - an Educational Reconstruction Approach (Andreas Grillenberger, Ralf Romeike) (2015)

- Bringing the Innovations in Data Management to CS Education - an Educational Reconstruction Approach (Andreas Grillenberger, Ralf Romeike) (2015)

- Informatik allgemeinbildend begreifen - INFOS 2015 (Jens Gallenbacher) (2015)

- Big-Data-Analyse im Informatikunterricht mit Datenstromsystemen - Ein Unterrichtsbeispiel (Ralf Romeike) (2015)

- Big Data im Informatikunterricht - Motivation und Umsetzung (Ralf Romeike) (2015)

- Big-Data-Analyse im Informatikunterricht mit Datenstromsystemen - Ein Unterrichtsbeispiel (Ralf Romeike) (2015)

- Humboldt gegen Orwell (Jörg Dräger, Ralph Müller-Eiselt) (2015)

- Die Herrschaftsformel - Wie Künstliche Intelligenz uns berechnet, steuert und unser Leben verändert (Kai Schlieter) (2015)

- Die digitale Bildungsrevolution - Der radikale Wandel des Lernens und wie wir ihn gestalten können (Jörg Dräger, Ralph Müller-Eiselt) (2015)

- ISSEP 2015 - Informatics in Schools. Curricula, Competences, and Competitions (Andrej Brodnik, Jan Vahrenhold) (2015)

- Big Data: Chancen, Risiken und Handlungsbedarf des Bundes - Ergebnisse einer Studie im Auftrag des Bundesamts für Kommunikation (Thomas Jarchow, Beat Estermann) (2015)

- Die vier Dimensionen der Bildung - Was Schülerinnen und Schüler im 21. Jahrhundert lernen müssen (Charles Fadel, Maya Bialik, Bernie Trilling) (2015)

- Cyberkrank! - Wie das digitalisierte Leben unsere Gesundheit ruiniert (Manfred Spitzer) (2015)

- 4. Big Data, Big Brother, und das Ende der Privatheit

- Big Data und Medienbildung - Zwischen Kontrollverlust, Selbstverteidigung und Souveränität in der digitalen Welt (Harald Gapski) (2015)

- Big Data und Medienbildung - eine Einleitung (2015)

- Warum sich Medienpädagogik mit Big Data Analytics befassen sollte (Isabel Zorn) (2015)

- Medienpädagogik und (Big) Data - Konsequenzen für die erziehungswissenschaftliche Medienforschung und -praxis (Valentin Dander, Sandra Aßmann)

- Gedanken zur Neuausrichtung der Medienkompetenzförderung angesichts Big Data (Niels Brüggen)

- Medienbildung in der Medienkatastrophe - Big Data als Herausforderung

- Zur Idee einer digitalen Bildungsidentität (Christopher Koska)

- Big Data und Medienbildung - eine Einleitung (2015)

- Freiheit Gleicheit Datenschutz - Warum wir eine Charta der digitalen Grundrechte brauchen (Martin Schulz) (2015)

- Mit Smartphone und WLAN lernt man besser. Ihre Telekom - Stiftungspropaganda zu Digitaltechnik und (eigenen) Geräten im Unterricht ("Bring Your Own Device") (Ralf Lankau) (2015)

- Unsere digitalen Grundrechte (Heiko Maas) (2015)

- Schöner smarter Staat (Stefan Schmitt) (2015)

- Wie verändert die Digitalisierung unser Denken und unseren Umgang mit der Welt? (Dirk Baecker) (2016)

- 300 Keywords Informationsethik - Grundwissen aus Computer- Netz- und Neue-Medien-Ethik sowie Maschinenethik (Oliver Bendel) (2016)

- Mobile Learning Design - Theories and Application (Daniel Churchill, Jie Lu, Thomas K.F. Chiu, Bob Fox) (2016)

- 24. Future Directions in Mobile Learning (Mark Pegrum)

- 24. Future Directions in Mobile Learning (Mark Pegrum)

- Weapons of Math Destruction - How Big Data Increases Inequality and Threatens Democracy (Cathy O’Neil) (2016)

- 2. Shell Shocked - My Journey of Disillusionment

- 5. Civilian Casualties - Justice in the Age of Big Data

- 9. No Safe Zone - Getting Insurance

- 10. The Targeted Citizen - Civic Life

- Machine Learning - The New AI (Ethem Alpaydin) (2016)

- The Quantified Self (Deborah Lupton) (2016)

- The Digital Transformation Playbook (David L. Rogers) (2016)

- Data Love - The Seduction and Betrayal of Digital Technologies (Roberto Simanowski) (2016)

- NZZ am Sonntag 3.01.2016 - Artikelserie "Zukunft der Arbeit" (2016)

- Bald füllen Roboter die Regale in den Filialen (Ueli Kneubühler) (2016)

- The Future of Jobs - Employment, Skills and Workforce Strategy for the Fourth Industrial Revolution (World Economic Forum (WEF)) (2016)

- Die Demaskierung des Digitalen durch ihre Propheten - Computer und Computerstimme als Erzieher? Eine Digitaleuphorie als Dystopie (Ralf Lankau) (2016)

- Personal and Personalized Learning (Stephen Downes) (2016)

- Auf dem Weg zum Arbeitsmarkt 4.0? - Mögliche Auswirkungen der Digitalisierung auf Arbeit und Beschäftigung in Deutschland bis 2030 (Juliane Landmann, Stefan Heumann, Bertelsmann Stiftung) (2016)

- SIGCSE 2016 - Memphis, TN, USA, March 02 - 05, 2016 (Carl Alphonce, Jodi Tims, Michael E. Caspersen, Stephen H. Edwards) (2016)

- Enhancing Teaching of Big Data by Using Real World Datasets (Anurag Nagar) (2016)

- SQL - From Traditional Databases to Big Data (Yasin N. Silva, Isadora Almeida, Michell Queiroz) (2016)

- Enhancing Teaching of Big Data by Using Real World Datasets (Anurag Nagar) (2016)

- Throwing Rocks at the Google Bus - How Growth Became the Enemy of Prosperity (Douglas Rushkoff) (2016)

- Mehr als 0 und 1 - Schule in einer digitalisierten Welt (Beat Döbeli Honegger) (2016)

- Wer viele SMS bekommt, ist kreditwürdiger (Patrice Siegrist) (2016)

- Die smarte Diktatur - Der Angriff auf unsere Freiheit (Harald Welzer) (2016)

- Denkcodes - Wie die Informatik menschliches Verhalten verändert hat. Und wie sie dies künftig tun wird. (Themendossier Schweizer Monat 5/16) (2016)

- Kultur der Digitalität (Felix Stalder) (2016)

- Digitale Dienstleistungen - Computer + Unterricht Nr. 102/2016 (Ulrich Gutenberg) (2016)

- Big Data’s Disparate Impact (Solon Barocas, Andrew D. Selbst) (2016)

- The Inevitable - Understanding the 12 Technological Forces That Will Shape Our Future (Kevin Kelly) (2016)

- Digitale Datenerhebung und -verwertung als Herausforderung für Medienbildung und Gesellschaft - Ein medienpädagogisches Diskussionspapier zu Big Data und Data Analytics (Sandra Aßmann, Niels Brüggen, Valentin Dander, Harald Gapski, Gerda Sieben, Angela Tillmann, Isabel Zorn) (2016)

- Bildung der Zukunft. Was unsere Kinder lernen müssen - Bernpunkt Ausgabe 12 (2016)

- Lehre vor dem Hintergrund der Digitalisierung (Kim Oliver Tokarski, Reinhard Riedl)

- Lehre vor dem Hintergrund der Digitalisierung (Kim Oliver Tokarski, Reinhard Riedl)

- Die Macht der Digitalisierung - Eine Serie in fünf Teilen (Tages Anzeiger) (2016)

- 1. Nächster Halt: Milchstrasse (Jürgen Schmidhuber, Christoph Fellmann) (2016)

- 2. Die effizienten Anarchisten (Christoph Fellmann) (2016)

- 4. Sind wir bereit für die Zukunft? (Balthasar Glättli, Marcel Dobler, Jean Christoph Schwaab, Philipp Loser) (2016)

- 1. Nächster Halt: Milchstrasse (Jürgen Schmidhuber, Christoph Fellmann) (2016)

- Aufstieg der digitalen Stammesgesellschaft - Die neue grosse Transformation (Oliver Fiechter, Philipp Löpfe) (2016)

- 1. Ändern sich die Medien, ändert sich die Gesellschaft - Big data vermischen Realität und Virtualität

- Das Ende der Demokratie - Wie die künstliche Intelligenz die Politik übernimmt und uns entmündigt (Yvonne Hofstetter) (2016)

- Beantwortung der Fragen zum Thema Digitalisierung der Enquetekommission «Kein Kind zurücklassen» (Matthias Burchardt) (2016)

- Digitalisierung und schulische Bildung - Anhörung durch die Enquetekommission «Kein Kind zurücklassen - Rahmenbedingungen, Chancen und Zukunft schulischer Bildung in Hessen», Thema - Digitalisierung (Ralf Lankau) (2016)

- Medienbildung und informatische Bildung - quo vadis? (Klaus Rummler, Beat Döbeli Honegger, Heinz Moser, Horst Niesyto) (2016)

- Digitales Wissen. Daten und Überwachung (Thomas Christian Bächle) (2016)

- Ich habe nur gezeigt, dass es die Bombe gibt - Die unheimliche Macht der Firma Cambridge Analytica (Hannes Grassegger, Mikael Krogerus) (2016)

- Big Data für Donald Trump - Fake News für die Intelligenzija (Thomas Knüwer) (2016)

- Wie unser Technik-Aberglaube allen schadet - "Trump hat mit Big Data gewonnen" (Sascha Lobo) (2016)

- smarte worte - Das kritische Lexikon der Digitalisierung (Martha Dörfler, Sabine Nuss, Patrick Stary, Rosa-Luxemburg-Stiftung) (2016)

- Big Data in Education - The digital future of learning, policy and practice (Ben Williamson) (2017)

- 2. Conceptualizing Digital Data - Data mining, analytics and imaginaries

- 3. Software, Code and Algorithms - Programming, automating and governing everyday life

- 4. Digital Education Governance - Political analytics, performativity and accountability

- 7. Rewiring Brains - Artificial intelligence, cognitive systems and neuroeducation

- 9. Conclusion - Programmable public pedagogies of software and big data

- 2. Conceptualizing Digital Data - Data mining, analytics and imaginaries

- The Datafied Society - Studying Culture Through Data (Mirko Tobias Schäfer, Karin van Es) (2017)

- Die Gesellschaft der Singularitäten - Zum Strukturwandel der Moderne (Andreas Reckwitz) (2017)

- Sensemaking - The Power of the Humanities in the Age of the Algorithm (Christian Madsbjerg) (2017)

- What works - Wie Verhaltensdesign die Gleichstellung revolutionieren kann (Iris Bohnet) (2017)

- Bildungshäppchen, frei Haus geliefert (Ralf Lankau) (2017)

- Das Netz in unsere Hand - Vom digitalen Kapitalismus zur Datendemokratie (Thomas Wagner) (2017)

- 2. Ein schlechtes Geschäft - Wie wir als Internetnutzer um unser Eigentum gebracht werden

- «Bauchgefühl ist nicht Wahrheit» (Lorraine Daston, David Hesse) (2017)

- Misconceptions About Computer Science (Peter Denning, Matti Tedre, Pat Yongpradit) (2017)

- Pädagogischer Mehrwert? - Digitale Medien in Schule und Unterricht (Christian Fischer) (2017)

- Pädagogischer Mehrwert? - Digitale Medien in Schule und Unterricht - eine Einführung (William Middendorf)

- Pädagogischer Mehrwert? - Digitale Medien in Schule und Unterricht - eine Einführung (William Middendorf)

- Weissbuch Arbeiten 4.0 (Bundesministerium für Arbeit und Soziales) (2017)

- Unsere digitale Zukunft - In welcher Welt wollen wir leben? (Carsten Könneker) (2017)

- 1. Digitale Demokratie statt Datendiktatur (Dirk Helbing, Bruno S. Frey, Gerd Gigerenzer, Ernst Hafen, Michael Hagner, Yvonne Hofstetter, Jeroen van den Hoven, Roberto V. Zicari, Andrej Zwitter) (2015)

- 2. Eine Strategie für das digitale Zeitalter (Dirk Helbing, Bruno S. Frey, Gerd Gigerenzer, Ernst Hafen, Michael Hagner, Yvonne Hofstetter, Jeroen van den Hoven, Roberto V. Zicari, Andrej Zwitter)

- 7. Big Data zum Nutzen von Gesellschaft und Menschheit (Andrej Zwitter, Roberto V. Zicari)

- 1. Digitale Demokratie statt Datendiktatur (Dirk Helbing, Bruno S. Frey, Gerd Gigerenzer, Ernst Hafen, Michael Hagner, Yvonne Hofstetter, Jeroen van den Hoven, Roberto V. Zicari, Andrej Zwitter) (2015)

- Data for the People - Wie wir die Macht über unsere Daten zurückerobern (Andreas Weigend) (2017)

- Bildung in der digitalen vernetzten Welt - Experteninterview mit Prof. Beat Döbeli Honegger (Beat Döbeli Honegger, Jürgen Luga) (2017)

- Everybody Lies - Big Data, New Data, and What the Internet Can Tell Us About Who We Really Are (Seth Stephens-Davidowitz) (2017)

- Der Mensch in der Arbeitswelt 4.0 (Sarah Genner, Larissa Probst, Rafel Huber, Birgit Werkmann-Karcher, Ellen Gundrum, Anna-Lena Majkovic) (2017)

- Genosse Big Brother (Kai Strittmatter) (2017)

- Software takes command - Herausforderungen der «Datafizierung» für die Medienpädagogik in Theorie und Praxis (Sabine Eder, Claudia Mikat, Angela Tillmann) (2017)

- Software takes command - Herausforderungen der «Datafizierung» für die Medienpädagogik in Theorie und Praxis

- Wie informatische Bildung hilft, die digitale Gesellschaft zu verstehen und mitzugestalten (Ralf Romeike) (2017)

- Software takes command - Herausforderungen der «Datafizierung» für die Medienpädagogik in Theorie und Praxis

- Das metrische Wir - Über die Quantifizierung des Sozialen (Steffen Mau) (2017)

- Machine Platform Crowd - Wie wir das Beste aus unserer digitalen Zukunft machen (Andrew McAfee, Erik Brynjolfsson) (2017)

- Wenn Maschinen intelligenter werden als Menschen (Matthias Sander) (2017)

- Die Technologie kann uns in eine goldene Zukunft führen (Dirk Helbing) (2017)

- Was heisst «big data»? - Digitalratgeber Teil 5 erschienen in Zeitlupe 9/17 (Beat Döbeli Honegger) (2017)

- «Die Digitalisierung macht uns Menschen noch mächtiger» (Michael Hengartner, Lino Guzzella, Peer Teuwsen) (2017)

- Smartphone-Demokratie - #FakeNews #Facebook #Bots #Populismus #Weibo #Civictech (Adrienne Fichter) (2017)

- The Datafication of Primary and Early Years Education - Playing with Numbers (Alice Bradbury, Guy Roberts-Holmes) (2017)

- «Die Hälfte unserer Schüler wird in Berufen arbeiten, die es heute noch gar nicht gibt» (Christoph Wittmer, Walter Bernet) (2017)

- Kein Mensch lernt digital - Über den sinnvollen Einsatz neuer Medien im Unterricht (Ralf Lankau) (2017)

- Technisierte Gesellschaft - Bestandesaufnahmen und kritische Analyse eines Hypes (Hans Baumann, Martin Gallusser, Walter Herzog, Ute Kotz, Christine Michel, Beat Ringger, Holger Schatz) (2017)

- Digitalität und Selbst (Heidrun Allert, Michael Asmussen, Christoph Richter) (2017)

- Die medialen Subjekte des 21. Jahrhunderts - Digitale Kompetenzen und/oderCritical Digital Citizenship (Felicitas Macgilchrist)

- Die medialen Subjekte des 21. Jahrhunderts - Digitale Kompetenzen und/oderCritical Digital Citizenship (Felicitas Macgilchrist)

- Schule neu denken und medial gestalten (Nina Grünberger, Klaus Himpsl, Petra Szucsich, Gerhard Brandhofer, Edmund Huditz, Michael Steiner) (2017)

- Tablet oder Papier: Ist das wirklich die Frage? (Gerald Geier, Elke Höfler)

- Tablet oder Papier: Ist das wirklich die Frage? (Gerald Geier, Elke Höfler)

- Was ist Netflix? (Beat Döbeli Honegger) (2017)

- Digitale Intelligenz - Warum die Generation Smartphone kein Problem, sondern unsere Rettung ist (Verena Gonsch) (2017)

- Notions of disruption - A collection of exploratory studies written and commissioned by the Swiss Science and Innovation Council SSIC (Schweizerischer Wissenschafts- und Innovationsrat) (2017)

- 3. Digital competences - Paper commissioned by the Swiss Science and Innovation Council SSIC (Sabine Seufert) (2017)

- 3. Digital competences - Paper commissioned by the Swiss Science and Innovation Council SSIC (Sabine Seufert) (2017)

- Die Bildung und das Netz - Wie leben und lernen wir im digitalen Klimawandel? (Martin Lindner) (2017)

- Medienethik - Computer + Unterricht Nr. 108/2017 (2017)

- Werkzeuge der digitalen Wirtschaft: Big Data, NoSQL & Co. - Eine Einführung in relationale und nicht-relationale Datenbanken (Andreas Meier) (2018)

- Digitalisierung und Bildung (Silke Ladel, Julia Knopf, Armin Weinberger) (2018)

- 6. Lehrerbildung in der digitalen Welt (Bardo Herzig, Alexander Martin)

- 6. Lehrerbildung in der digitalen Welt (Bardo Herzig, Alexander Martin)

- Digitalisierung: Segen oder Fluch - Wie die Digitalisierung unsere Lebens- und Arbeitswelt verändert (Dietmar Wolff, Richard Göbel) (2018)

- 4. Big Data (Richard Göbel)

- 4. Big Data (Richard Göbel)

- Second Handbook of Information Technology in Primary and Secondary Education (Joke Voogt, Gerald Knezek, Rhonda Christensen, Kwok-Wing Lai) (2018)

- 79. Researching the Design and Evaluation of Information Technology Tools for Education (Eric Bruillard, Georges-Louis Baron)

- 79. Researching the Design and Evaluation of Information Technology Tools for Education (Eric Bruillard, Georges-Louis Baron)

- Click Here to Kill Everybody - Security and Survival in a Hyper-connected World (Bruce Schneier) (2018)

- Reinventing Capitalism in the Age of Big Data (Viktor Mayer-Schönberger, Thomas Ramge) (2018)

- Artificial Unintelligence (Meredith Broussard) (2018)

- Data Science (John D. Kelleher, Brendan Tierney) (2018)

- If...Then - Algorithmic Power and Politics (Taina Bucher) (2018)

- «Das ist immer noch ein Hype» (Rolf Pfeifer, Matthias Meili) (2018)

- Automating Inequality (Virginia Eubanks) (2018)

- Mit digitalen Geräten lernen Schüler besser - und lieber (Regula Freuler) (2018)

- Medien, Bildung und Wissen in der Hochschule (Andreas Weich, Julius Othmer, Katharina Zickwolf) (2018)

- 8. Big Data in der Hochschullandschaft (Sonja Hardell, Sandra Lichtenberg, Martin Reimers, Heidrun Allert, Sabine Reisas)

- 8. Big Data in der Hochschullandschaft (Sonja Hardell, Sandra Lichtenberg, Martin Reimers, Heidrun Allert, Sabine Reisas)

- Learning Analytics Goes to School (Andrew Krumm, Barbara M. Means, Marie A. Bienkowski) (2018)

- Schule 4.0 - Bildung in der digitalen Welt (2018)

- Orwell 3.0 (Matthias Burchardt)

- Orwell 3.0 (Matthias Burchardt)

- Enhancing Learning and Teaching with Technology - What the Research Says (Rose Luckin) (2018)

- Artificial Intelligence And Big Data Technologies To Close The Achievement Gap (Ben du Boulay, Alexandra Poulovasillis, Wayne Holmes, Manolis Mavrikis)

- Artificial Intelligence And Big Data Technologies To Close The Achievement Gap (Ben du Boulay, Alexandra Poulovasillis, Wayne Holmes, Manolis Mavrikis)

- Stumme Medien - Vom Verschwinden der Computer in Bildung und Gesellschaft (Roberto Simanowski) (2018)

- The Fourth Education Revolution (Anthony Seldon, Oladimeji Abidoye) (2018)

- Matchplan - Die neue Fussball-Matrix (Christoph Biermann) (2018)

- Mehr Laptop-Trainer, bitte! - Big data im Fussball (Dirk von Gehlen) (2018)

- Digitale Bildung versus Informatikunterricht? (2018)

- Datenmanagement als Thema für den Informatikunterricht - Ein Überblick über die Grundlagen des Fachgebiets aus informatikdidaktischer Sicht (Andreas Grillenberger, Ralf Romeike) (2018)

- Big Up 4 Big Data - Ein Stationsspiel zur Einführung in den Themenkomplex "Big Data“ (Katharina Gmeinwieser) (2018)

- Datenmanagement als Thema für den Informatikunterricht - Ein Überblick über die Grundlagen des Fachgebiets aus informatikdidaktischer Sicht (Andreas Grillenberger, Ralf Romeike) (2018)

- (Un)berechenbar? - Algorithmen und Automatisierung in Staat und Gesellschaft (Resa Mohabbat Kar, Basanta Thapa, Peter Parycek) (2018)

- EdMedia 2018 (2018)

- A Teacher Professional Development Platform in the Big Data Trend - The Development and Application of “TEAM Model Smarter Discussion Room” (I-Hua Chang, Cheng-Mei Hsu, Chuan-Wei Wu)

- A Teacher Professional Development Platform in the Big Data Trend - The Development and Application of “TEAM Model Smarter Discussion Room” (I-Hua Chang, Cheng-Mei Hsu, Chuan-Wei Wu)

- «Vieles ist blankes Marketing» (Gerd Antes, Felix Straumann) (2018)

- HDI 2018 - 8. Fachtagung des GI-Fachbereichs Informatik und Ausbildung/Didaktik der Informatik (Nadine Bergner, René Röpke, Ulrik Schroeder, Detlef Krömker) (2018)

- Was ist Data Science ? - Ermittlung der informatischen Inhalte durch Analyse von Studienangeboten (Andreas Grillenberger, Ralf Romeike)

- Was ist Data Science ? - Ermittlung der informatischen Inhalte durch Analyse von Studienangeboten (Andreas Grillenberger, Ralf Romeike)

- Soziale Medien und Kritische Theorie (Christian Fuchs) (2018)

- Errichtet China eine Big-Data-Diktatur? Nein. (Marcus Hernig) (2018)

- Mit der Blockchain gegen das Elend (Holger Allch) (2018)

- Die Neuerfindung der Diktatur - Wie China den digitalen Überwachungsstaat aufbaut und uns damit herausfordert (Kai Strittmatter) (2018)

- Wähler, wir wissen, wo du wohnst (Christina Neuhaus) (2018)

- The Model Thinker - What you neeed to know to make data work for you (Scott E. Page) (2018)

- Auch Maschinen können benachteiligen (Andrea Fischer) (2018)

- Lehrmittel in einer digitalen Welt (Beat Döbeli Honegger, Michael Hielscher, Werner Hartmann) (2018)

- Digital Strategy (Université de Genève) (2018)

- Praktiken der Überwachten - Öffentlichkeit und Privatheit im Web 2.0 (Martin Stempfhuber, Elke Wagner) (2018)

- 4. Die Zurichtung des Privaten (Armin Nassehi)

- 9. Neue Trends im Strukturwandel der Privatheit (Martin Stempfhuber)

- 4. Die Zurichtung des Privaten (Armin Nassehi)

- Digitale Transformation - Beiträge zur Lehrerinnen- und Lehrerbildung 2/2018 (2018)

- Digitalisierung als Mediatisierungsschub im Schulfeld - Sondierungsversuche in unterschiedlichen Diskursdomänen aus medienpädagogischer Sicht (Klaus Rummler) (2018)

- Digitalisierung als Mediatisierungsschub im Schulfeld - Sondierungsversuche in unterschiedlichen Diskursdomänen aus medienpädagogischer Sicht (Klaus Rummler) (2018)

- Digital Objects, Digital Subjects - Interdisciplinary Perspectives on Capitalism, Labour and Politics in the Age of Big Data (David Chandler, Christian Fuchs) (2019)

- Die Zukunft der Datenökonomie - Zwischen Geschäftsmodell, Kollektivgut und Verbraucherschutz (Carsten Ochs, Michael Friedewald, Thomas Hess, Jörn Lamla) (2019)

- Digitalisierung – Nicht nur irgendwas mit Medien - Schule leiten | Ausgabe Nr. 17/2019 (2019)

- Was bedeutet «Big Data»? - Gedanken zu einer Schule 4.0 (Helmut Lungershausen)

- Was bedeutet «Big Data»? - Gedanken zu einer Schule 4.0 (Helmut Lungershausen)

- Speichern und Strafen - Die Gesellschaft im Datengefängnis (Adrian Lobe) (2019)

- Deep Learning (John D. Kelleher) (2019)

- Der globale Green New Deal - Warum die fossil befeuerte Zivilisation um 2028 kollabiert – und ein kühner ökonomischer Plan das Leben auf der Erde retten kann (Jeremy Rifkin) (2019)

- Digitalisierung als De-Humanisierung von Schulen - Vom Unterrichten zum Vermessen. Bildungseinrichtungen unter dem Diktat von Betriebswirtschaft und Datenökonomie (Ralf Lankau) (2019)

- Geschichten für eine technisierte Welt (Matthias Schüssler) (2019)

- «Die Angst vor künstlicher Intelligenz ist Stoff für Hollywood» (Garri Kasparow, Joachim Laukenmann) (2019)

- Worauf ich Wert lege, wenn es um die zunehmende Digitalisierung geht... (Ralf Lankau) (2019)

- Von Datenmanagement zu Data Literacy - Informatikdidaktische Aufarbeitung des Gegenstandsbereichs Daten für den allgemeinbildenden Schulunterricht (Andreas Grillenberger) (2019)

- SIGCSE 2019 - Proceedings of the 50th ACM Technical Symposium on Computer Science Education, SIGCSE 2019, Minneapolis, MN, USA, February 27 - March 02, 2019 (Elizabeth K. Hawthorne, Manuel A. Pérez-Quiñones, Sarah Heckman, Jian Zhang 0036) (2019)

- A Module-based Approach to Teaching Big data and Cloud Computing Topics at CS Undergraduate Level (Debzani Deb, M. Muztaba Fuad, Keith Irwin) (2019)

- A Module-based Approach to Teaching Big data and Cloud Computing Topics at CS Undergraduate Level (Debzani Deb, M. Muztaba Fuad, Keith Irwin) (2019)

- Digitale Medien und Unterricht: Eine Kontroverse (Paula Bleckmann, Ralf Lankau) (2019)

- 4. Vom Unterrichten zum Bildungscontrolling - Über die Blindheit gegenüber den Zielen der »Digitalisierung« von Schule und Unterricht (Ralf Lankau)

- 4. Vom Unterrichten zum Bildungscontrolling - Über die Blindheit gegenüber den Zielen der »Digitalisierung« von Schule und Unterricht (Ralf Lankau)

- Alt-Right oder Greta? - Tendenzen und Optionen der Digitalisierung im Übergang in eine neue Epoche (Lisa Rosa) (2019)

- Humanismus vs. Data-Ismus (Ralf Lankau) (2019)

- Dark Data is your friend (Mark Whitehorn) (2019)

- Machine behaviourism - future visions of ‘learnification’ and ‘datafication’ across humans and digital technologies (Jeremy Knox, Ben Williamson, Siân Bayne) (2019)

- Bildung und Digitalisierung - AUS POLITIK UND ZEITGESCHICHTE (APUZ 27-28/2019) (2019)

- Mehr als Digitalkompetenz - Bildung und Big Data (Harald Gapski)

- Mehr als Digitalkompetenz - Bildung und Big Data (Harald Gapski)

- Das Lehrmittel zwischen Mythos und Vision - profil 2/2019 (2019)

- Lehrmittel im Kreuzfeuer der Interessen (Beat Petermann, Dagmar Rösler, Erwin Sommer, Bernhard Kobel, Christian Graf)

- Lehrmittel im Kreuzfeuer der Interessen (Beat Petermann, Dagmar Rösler, Erwin Sommer, Bernhard Kobel, Christian Graf)

- OECD Lernkompass 2030 - OECD-Projekt Future of Education and Skills 2030 - Rahmenkonzept des Lernens (2019)

- Daten in der Bildung - Daten für die Bildung - Grundlagen und Ansätze zur Entwicklung einer Datennutzungspolitik für den Bildungsraum Schweiz (educa.ch Schweizerisches Medieninstitut für Bildung und Kultur) (2019)

- Should Robots Replace Teachers? - AI and the Future of Education (Neil Selwyn) (2019)

- Routenplaner #Digitale Bildung (Axel Krommer, Martin Lindner, Philippe Wampfler, Dejan Mihajlović, Jöran Muuß-Merholz) (2019)

- Von der «Schulcloud» zur lebenslangen «Bildungsakte» - Wohin bewegt sich das digitale Bildungssystem? (Martin Lindner)

- Von der «Schulcloud» zur lebenslangen «Bildungsakte» - Wohin bewegt sich das digitale Bildungssystem? (Martin Lindner)

- Ansturm der Algorithmen - Die Verwechslung von Urteilskraft mit Berechenbarkeit (Wolf Zimmer) (2019)

- Informatik für alle - 18. GI-Fachtagung Informatik und Schule (Arno Pasternak) (2019)

- Entwicklung und Reflexion einer Unterrichtssequenz zum Maschinellen Lernen als Aspekt von Data Science in der Sekundarstufe II (Simone Opel, Michael Schlichtig, Carsten Schulte, Rolf Biehler, Daniel Frischemeier, Susanne Podworny, Thomas Wassong)

- Maschinelles Lernen im Unterricht mit Jupyter Notebook (Michael Schlichtig, Simone Opel, Carsten Schulte, Rolf Biehler, Daniel Frischemeier, Susanne Podworny, Thomas Wassong)

- Entwicklung und Reflexion einer Unterrichtssequenz zum Maschinellen Lernen als Aspekt von Data Science in der Sekundarstufe II (Simone Opel, Michael Schlichtig, Carsten Schulte, Rolf Biehler, Daniel Frischemeier, Susanne Podworny, Thomas Wassong)

- Diskriminierungsrisiken durch Verwendung von Algorithmen - Eine Studie, erstellt mit einer Zuwendung der Antidiskriminierungsstelle des Bundes. (Carsten Orwat) (2019)

- Challenges of Digital Inequality. Digital Education | Digital Work | Digital Life - Proceedings of the Weizenbaum Conference 2019 (2019)

- Ein Algorithmus hat kein Taktgefühl - Wo künstliche Intelligenz sich irrt, warum uns das betrifft und was wir dagegen tun können (Katharina A. Zweig) (2019)

- The Datafication of Education (Juliane Jarke, Andreas Breiter) (2019)

- Gutachten der Datenethikkommission (dek Datenethikkommission) (2019)

- Learning Analytics und Big Data in der Bildung - Zur notwendigen Entwicklung eines datenpolitischen Alternativprogramms (Sigrid Hartong) (2019)

- Wie Maschinen lernen - Künstliche Intelligenz verständlich erklärt (Kristian Kersting, Christoph Lampert, Constantin Rothkopf) (2019)

- 1. Einleitung (Jannik Kossen, Fabrizio Kuruc, Maike Elisa Müller)

- 19. Big Data (Christian Hölzer, Elena Natterer)

- 1. Einleitung (Jannik Kossen, Fabrizio Kuruc, Maike Elisa Müller)

- On Digital Disinformation and Democratic Myths (David Karpf) (2019)

- Herausforderungen der künstlichen Intelligenz - Bericht der interdepartementalen Arbeitsgruppe «Künstliche Intelligenz» an den Bundesrat (Interdepartementale Arbeitsgruppe künstliche Intelligenz) (2019)

- Der gesteuerte Mensch? - Digitalpakt Bildung - eine Kritik (Gottfried Böhme) (2020)

- Calling Bullshit - The Art of Skepticism in a Data-Driven World (Carl T. Bergstrom, Jevin D. West) (2020)

- The Fourth Education Revolution Reconsidered - Will Artificial Intelligence Liberate Or Infantilise Humanity (Anthony Seldon, Oladimeji Abidoye, Timothy Metcalf) (2020)

- 30-Second Numbers - The 50 key topics for understanding numbers and how we use them (Niamh Nic Daéid, Christian Cole) (2020)

- Big Data, Datafizierung und digitale Artefakte (Stefan Iske, Johannes Fromme, Dan Verständig, Katrin Wilde) (2020)

- Digitalisierung und Datafizierung - Big Data als Herausforderung für die Schulbildung (Regine Buschauer, Christian Wadephul)

- Grundzüge einer Kritischen Politischen Ökonomie von Big Data Analytics - und ihre bildungstheoretischen Implikationen (Valentin Dander)

- Die Ordnung der Daten - Zum Verhältnis von Big Data und Bildung (Dan Verständig)

- Digitalisierung und Datafizierung - Big Data als Herausforderung für die Schulbildung (Regine Buschauer, Christian Wadephul)

- Data Feminism (Catherine D'Ignazio, Lauren F. Klein) (2020)

- «Stellen Sie sich einen Bauernhof von Schaffhausen bis Genf vor» (Christian Jörg, Mario Stäuble) (2020)

- Towards Digital Enlightenment - Essays on the Dark and Light Sides of the Digital Revolution (Dirk Helbing) (2020)

- Diginomics verstehen - Ökonomie im Licht der Digitalisierung (Thieß Petersen) (2020)

- Digitalisierung - Subjekt - Bildung - Kritische Betrachtungen der digitalen Transformation (Valentin Dander, Patrick Bettinger, Estella Ferraro, Christian Leineweber, Klaus Rummler) (2020)

- Let's rock education - Was Schule heute lernen muss (Daniel Jung) (2020)

- Jahrbuch Medienpädagogik 15 - Erziehungswissenschaftliche und medienpädagogische Online-Forschung: Herausforderungen und Perspektiven (Johannes Fromme, Stefan Iske, Therese Leik, Steffi Rehfeld, Jasmin Bastian, Manuela Pietraß, Klaus Rummler) (2020)

- Personal Data für Entscheidungsimpulse setzende Akteurinnen und Akteure (Christian Swertz, Alessandro Barberi)

- Personal Data für Entscheidungsimpulse setzende Akteurinnen und Akteure (Christian Swertz, Alessandro Barberi)

- Jahrbuch Medienpädagogik 17 - Lernen mit und über Medien in einer digitalen Welt (Klaus Rummler, Ilka Koppel, Sandra Aßmann, Patrick Bettinger, Karsten D. Wolf) (2020)

- Erfassen und modellieren - Covid-19 und die Politik von «Big Data» (Felix Stalder) (2020)

- connected 03 (Dorit Assaf, Marc Feige, Jörg Graf, Martin Guggisberg, Roger Mäder, Björn Maurer, Stanley Schwab, Helen Stadelmann) (2020)

- 5. Daten, Daten, Daten (Dorit Assaf, Marc Feige, Jörg Graf, Martin Guggisberg, Roger Mäder, Björn Maurer, Igo Schaller, Stanley Schwab, Helen Stadelmann)

- 5. Daten, Daten, Daten (Dorit Assaf, Marc Feige, Jörg Graf, Martin Guggisberg, Roger Mäder, Björn Maurer, Igo Schaller, Stanley Schwab, Helen Stadelmann)

- Was macht die Digitalisierung mit den Hochschulen? - Einwürfe und Provokationen (Marko Demantowsky, Gerhard Lauer, Robin Schmidt, Bert te Wildt) (2020)

- Ist das Digitalisierung oder kann das weg? (Angelika Beranek)

- Ist das Digitalisierung oder kann das weg? (Angelika Beranek)

- «Die Digitalisierung verwandelt uns in Zielscheiben» (Timothy Snyder, Pascal Blum) (2020)

- Verspielte Zukunft durch digitale Bildungswunder - Anmerkungen zum Beitrag „3 Fragen an …“ mit Antworten von Dr. Nando Stöcklin, PH Bern, unter dem Titel: „Arbeit für eine verspielte Zukunft“. (Ralf Lankau) (2020)

- Medienpädagogik als Schlüsseldisziplin in einer mediatisierten Welt - Perspektiven aus Theorie, Empirie und Praxis - Festschrift für Dorothee M. Meister (Henrike Friedrichs-Liesenkötter, Lara Gerhardts, Anna-Maria Kamin, Sonja Kröger) (2020)

- «Big Data» aus der Perspektive von Informatischer Bildung und Medienpädagogik - Bildung in einer datifizierten Gesellschaft (Johannes Magenheim)

- «Big Data» aus der Perspektive von Informatischer Bildung und Medienpädagogik - Bildung in einer datifizierten Gesellschaft (Johannes Magenheim)

- Studierende - Medien - Universität - Einblicke in studentische Medienwelten (Sandra Hofhues, Mandy Schiefner, Sandra Aßmann, Taiga Brahm) (2020)

- Learning Analytics in der Hochschule - Theoretisches Potenzial oder praktischer Nutzen? (Antonia Weber, Peter Salden)

- QualityLand 2.0 (Marc-Uwe Kling) (2020)

- Open Access Zeitschriften in den Bildungs- und Erziehungswissenschaften - Ausgewählte Aspekte zum Betrieb wissenschaftlicher Fachzeitschriften (Klaus Rummler) (2021)

- Kritik der Digitalität (Jan Distelmeyer) (2021)

- 1. Digitalität und Kritik

- 1. Digitalität und Kritik

- Wenn KI, dann feministisch - Impulse aus Wissenschaft und Aktivismus (netzforma* e.V) (2021)

- Maschinenbewusstsein - Die neue Stufe der KI – wie weit wollen wir gehen? (Ralf Otte) (2021)

- Login 195/196 (2021)

- Big Data (Ziawasch Abedjan) (2021)

- Big Data aus Perspektive der Informatikdidaktik (Andreas Grillenberger)

- Methodik für Datenprojekte im Informatikunterricht (Lukas Höper, Sven Hüsing, Hülya Malatyali, Carsten Schulte, Lea Budde)

- Datenflussorientierte Big-Data-Analyse (Andreas Grillenberger)

- AI Replugged - Das Gute-Äffchen-Böse-Äffchen-Spiel mit Orange 3 (Lennard Kerber)

- Von Media Computation zu Data Science - in SNAP! (Jens Mönig, Jadga Hügle)

- Big Data (Ziawasch Abedjan) (2021)

- Pädagogik 05/2021 (2021)

- Digitalisierung aus pädagogische Perspektive (2021)

- 1. Was machen wir mit der Digitalisierung? (Beat Döbeli Honegger) (2021)

- 3. Digitalisierung und Bildungsgerechtigkeit (Johannes Giesinger) (2021)

- 1. Was machen wir mit der Digitalisierung? (Beat Döbeli Honegger) (2021)

- Die Macht der Plattformen - Politik in Zeiten der Internetgiganten (Michael Seemann) (2021)

- Handbuch Lernen mit digitalen Medien (Gerold Brägger, Hans-Günter Rolff) (2021)

- 18. Learning Analytics - Erfahrungen aus kalifornischen Schulen (Jenny Jungeblut)

- 18. Learning Analytics - Erfahrungen aus kalifornischen Schulen (Jenny Jungeblut)

- Der gläserne Schüler (Fabian Kretschmer) (2021)

- Pädagogik 07-08/2021 (2021)

- Digitalisierung und Bildungsgerechtigkeit (Johannes Giesinger) (2021)

- Digitalisierung und Bildungsgerechtigkeit (Johannes Giesinger) (2021)

- Autonom und mündig am Touchscreen (Ralf Lankau) (2021)

- AI – Limits and Prospects of Artificial Intelligence (Peter Klimczak, Christer Petersen) (2021)

- Informatik - Bildung von Lehrkräften in allen Phasen - 19. GI-Fachtagung Informatik und Schule (Ludger Humbert) (2021)

- Datenbewusstsein: Aufmerksamkeit für die eigenen Daten (Lukas Höper, Carsten Schulte)

- Wichtige Kompetenzen für eine lebenswerte Zukunft (Andera Gadeib, Stephan Noller)

- Datenbewusstsein: Aufmerksamkeit für die eigenen Daten (Lukas Höper, Carsten Schulte)

- Klick - Wie wir in einer digitalen Welt die Kontrolle behalten und die richtigen Entscheidungen treffen (Gerd Gigerenzer) (2021)

- Wehe, wenn sie aus der Reihe tanzen - Bildungsbeilage der NZZ am Sonntag vom 26.09.2021 (2021)

- Ein Besuch beim Dateninterpretierer von Swiss Re, Ringier und CIA (Edith Hollenstein) (2021)

- Entsolidarisiert die Smartwatch? - Szenarien für ein datafiziertes Gesundheitssystem (Jakub Samochowiec, Andreas Müller2) (2021)

- Wo wir künftig unsere persönlichsten Daten zeigen müssen (Jacqueline Büchi) (2021)

- Optimierung in der Medienpädagogik (Patrick Bettinger, Klaus Rummler, Karsten D. Wolf) (2021)

- Subjektwissen als Bildungsperspektive junger Erwachsener - Self-Tracking-Apps als digitale Optimierungstechnologien im Spannungsgefüge von Kontrolle und Selbstermächtigung (Bianca Burgfeld-Meise, Lukas Dehmel)

- Subjektwissen als Bildungsperspektive junger Erwachsener - Self-Tracking-Apps als digitale Optimierungstechnologien im Spannungsgefüge von Kontrolle und Selbstermächtigung (Bianca Burgfeld-Meise, Lukas Dehmel)

- Pädagogisches Wissen im Lichte digitaler und datengestützter Selbstoptimierung (Estella Ferraro, Sabrina Schröder, Christiane Thompson) (2021)

- Das Ende der Prüfung als Anfang des ‹Data Realism›? (Martin Karcher)

- Das Ende der Prüfung als Anfang des ‹Data Realism›? (Martin Karcher)

- Sachunterricht in der Informationsgesellschaft (Andrea Becher, Eva Blumberg, Thomas Goll, Kerstin Michalik, Claudia Tenberge) (2022)

- Sachunterricht in der Informationsgesellschaft (Friedrich Gervé) (2022)

- Sachunterricht in der Informationsgesellschaft (Friedrich Gervé) (2022)

- Education andTechnology - Key Issues and Debates (3rd edition) (Neil Selwyn) (2022)

- Kompetenzmodelle für den Digitalen Wandel - Orientierungshilfen und Anwendungsbeispiele (Ralf Knackstedt, Jürgen Sander, Jennifer Kolomitchouk) (2022)

- 1. Kompetenzen für den digitalen Wandel erfordern Orientierungshilfe (Ralf Knackstedt, Marco Di Maria, Jennifer Kolomitchouk, Jürgen Sander)

- 1. Kompetenzen für den digitalen Wandel erfordern Orientierungshilfe (Ralf Knackstedt, Marco Di Maria, Jennifer Kolomitchouk, Jürgen Sander)

- Was Hänschen nicht lernt... - Kritische Statements zur Digitalisierung in der Grundschule (Ralf Lankau) (2022)

- Fachliche Bildung in der digitalen Welt - Digitalisierung, Big Data und KI im Forschungsfokus von 15 Fachdidaktiken (Volker Frederking, Ralf Romeike) (2022)

- New Perspectives in Critical Data Studies - The Ambivalences of Data Power (Andreas Hepp, Juliane Jarke, Leif Kramp) (2022)

- Indigenous Peoples, Data, and the Coloniality of Surveillance (Donna Cormack, Tahu Kukutai)

- Worker Perspectives on Designs for a Crowdwork Co-operative (Jo Bates, Alessandro Checco, Elli Gerakopoulou)

- Indigenous Peoples, Data, and the Coloniality of Surveillance (Donna Cormack, Tahu Kukutai)

- Professionalisierung von Grundschullehrkräften - Kontext, Bedingungen und Herausforderungen (Ingelore Mammes, Carolin Rotter) (2022)

- Mehr als Distance Learning - Digitalisierung als Notwendigkeit, Herausforderung und Chance in der Lehramtsbildung für die Grundschule (Inga Gryl)

- Mehr als Distance Learning - Digitalisierung als Notwendigkeit, Herausforderung und Chance in der Lehramtsbildung für die Grundschule (Inga Gryl)

- Rhetoriken des Digitalen - Adressierungen an die Pädagogik (Miguel Zulaica y Mugica, Klaus-Christian Zehbe) (2022)

- Datenwissenschaften und Gesellschaft - Die Genese eines transversalen Wissensfeldes (Philippe Saner) (2022)

- Algorithmen und Autonomie - Interdisziplinäre Perspektiven auf das Verhältnis von Selbstbestimmung und Datenpraktiken (Dan Verständig, Christina Kast, Janne Stricker, Andreas Nürnberger) (2022)

- Algorithmen und Autonomie - Interdisziplinäre Perspektiven auf das Verhältnis von Selbstbestimmung und Datenpraktiken

- Algorithmen und Autonomie - Interdisziplinäre Perspektiven auf das Verhältnis von Selbstbestimmung und Datenpraktiken

- Kalibrierung der Wissenschaft - Auswirkungen der Digitalisierung auf die wissenschaftliche Erkenntnis (Nicola Mößner, Klaus Erlach) (2022)

- Digital Futures for Learning - Speculative Methods and Pedagogies (Jen Ross) (2022)

- Chat GPT: Der Roboter schreibt nicht, er schwafelt - Neun Missverständnisse um die Künstliche Intelligenz (Eduard Kaeser) (2022)

- The Abundant University - Remaking Higher Education for a Digital World (Michael D. Smith) (2023)

- KI-Expertin: «Krasse Reduktion der Realität» (Cornelia Diethelm, Tina Fischer) (2023)

- Computing Education in (the digital) Transformation (Tilman Michaeli) (2023)

- Mensch und Maschine - Herausforderungen durch Künstliche Intelligenz (Deutscher Ethikrat) (2023)

- 2. Zentrale Entwicklungen und technische Grundlagen Künstlicher Intelligenz

- Is Education Losing the Race with Technology? - AI's Progress in Maths and Reading (OECD Organisation for Economic Co-operation and Development) (2023)

- Conjuring With Computation - A Manual Of Magic And Computing For Beginners (Paul Curzon, Peter W. McOwan) (2023)

- Die KI war's! - Von absurd bis tödlich: Die Tücken der künstlichen Intelligenz (Katharina A. Zweig) (2023)

- Digital Leadership - Schulen im digitalen Wandel führen (Tobias Röhl, Johannes Breitschaft, Eliane Burri, Nicole Wespi) (2023)

- Informatik-Monitor 2023/24 (Lutz Hellmig, Bentley Schieckoff, Richard Schwarz, Felix Süßenbach) (2023)

- KI-Tools für den Unterricht (Inez De Florio-Hansen) (2023)

- Datafizierung in der Bildung - Kritische Perspektiven auf digitale Vermessung in pädagogischen Kontexten (Mandy Schiefner, Sandra Hofhues, Andreas Breiter) (2023)

- Zum Anspruch, Bildung zu vermessen - Eine (knappe) Einleitung in den Band (Mandy Schiefner-Rohs, Sandra Hofhues, Andreas Breiter)

- Zum Anspruch, Bildung zu vermessen - Eine (knappe) Einleitung in den Band (Mandy Schiefner-Rohs, Sandra Hofhues, Andreas Breiter)

- Zwischen Macht und Mythos - Eine kritische Einordnung aktueller KI-Narrative (Rainer Rehak) (2023)

- Digital ist besser?! - Psychologie der Online- und Mobilkommunikation (Markus Appel, Fabian Hutmacher, Christoph Mengelkamp, Jan-Philipp Stein, Silvana Weber) (2023)

- Künstliche Intelligenz (Jan-Philipp Stein, Tanja Messingschlager, Fabian Hutmacher)

- Künstliche Intelligenz (Jan-Philipp Stein, Tanja Messingschlager, Fabian Hutmacher)

- KI für Lehrkräfte - ein offenes Lehrbuch (Colin de la Higuera, Jotsna Iyer) (2024)

- Technofeudalism - What Killed Capitalism (Giannis Varoufakis) (2024)

- AI Report - by the European Digital Education Hub’s Squad on Artificial Intelligence in Education (European Digital Education Hub) (2024)

- Populismus und Protest - Demokratische Öffentlichkeiten und Medienbildung in Zeiten von Rechtsextremismus und Digitalisierung (Sabrina Schenk) (2024)

- Algorithmische Sozialtechnologien als neue Bildungsherausforderungen - Eine systemtheoretische Betrachtung zu Big Data Analytics und Social Scoring (Harald Gapski)

- Algorithmische Sozialtechnologien als neue Bildungsherausforderungen - Eine systemtheoretische Betrachtung zu Big Data Analytics und Social Scoring (Harald Gapski)

- Artificial intelligence and illusions of understanding in scientific research (Lisa Messer, M. J. Crockett) (2024)

- Die Verselbstständigung des Kapitalismus - Wie KI Menschen und Wirtschaft steuert und für mehr Bürokratie sorgt (Mathias Binswanger) (2024)

- Wenn KI das Tempo vorgibt - Lernen mit und trotz künstlicher Intelligenz (Doris Weßels, Klaus Zierer, Isabel Grünewald) (2024)

- The Singularity is nearer (Ray Kurzweil) (2024)

- DELFI 2024 (Sandra Schulz, Natalie Kiesler) (2024)

- The interplay between rich and big data in programming education research (Hieke Keuning) (2024)

- The interplay between rich and big data in programming education research (Hieke Keuning) (2024)

- Handbuch Lernen mit digitalen Medien (3. Auflage) - Wege der Transformation (Gerold Brägger, Hans-Günter Rolff) (2025)

- 35. Chatbot oder Verbot? (Birgita Dusse)

- 35. Chatbot oder Verbot? (Birgita Dusse)

Ralf

Ralf Andreas

Andreas Ralf

Ralf Cathy

Cathy Beat

Beat Dirk

Dirk Katharina A.

Katharina A. Andrew

Andrew Erik

Erik Carsten

Carsten

Biblionetz-History

Biblionetz-History